Bilingual autoencoder-based efficient harmonization of multi-source private data for accurate predictive modeling

Taek-Ho Lee, 이정혜, Chi-Hyuck Jun (2021) · information-sciences 568:403-426 · DOI ↗

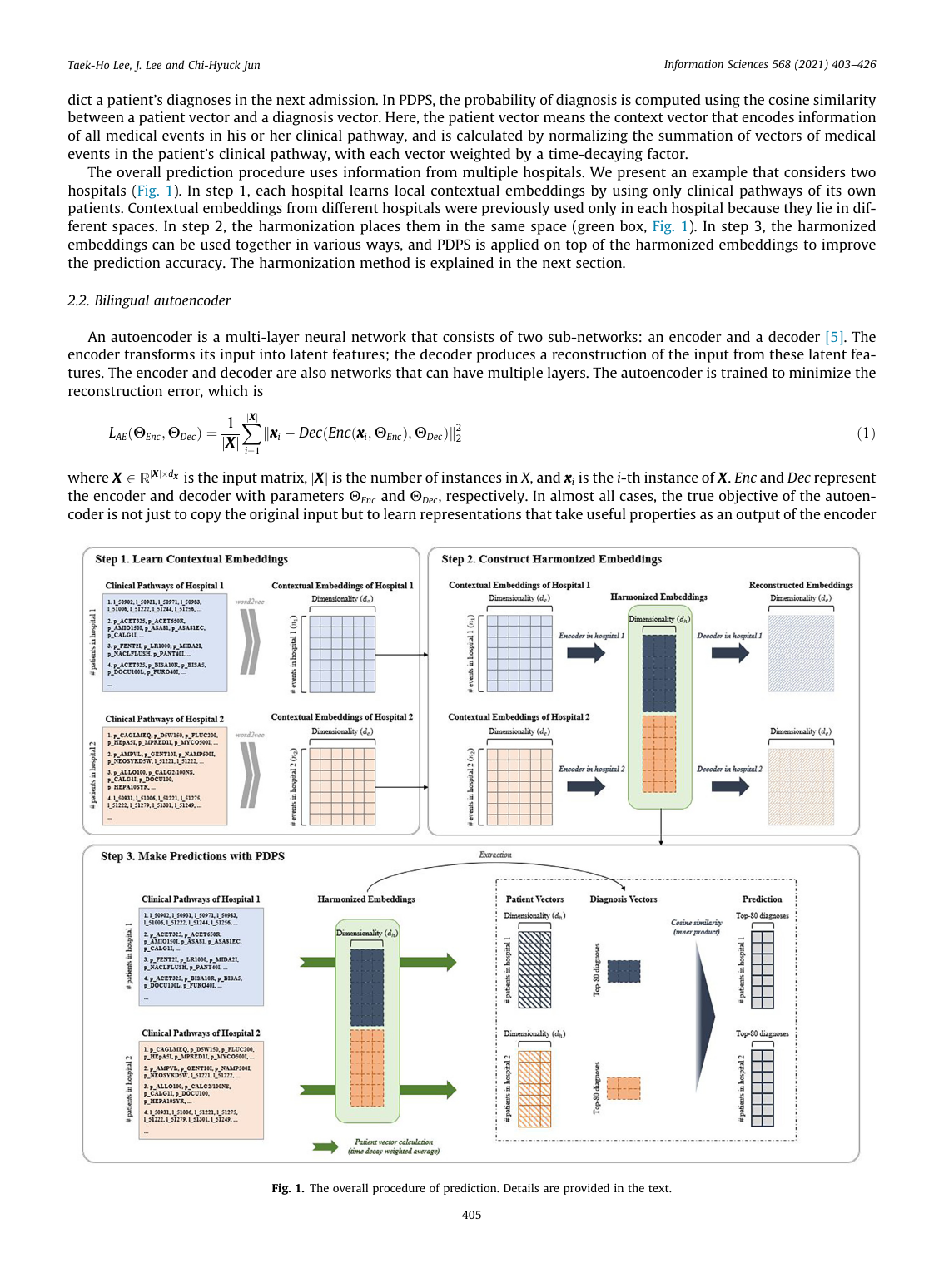

이정혜 의 “소스별 분리 + 공유 표현” 메타-아키텍처 의 첫 명시적 구현 — HarmoAE (Bilingual Autoencoder). 다기관 EHR contextual embedding 을 공유 hidden space 로 align. 2 단계 학습 (사전 학습 → 합동 학습) 으로 biased 병원 의 distortion 방지. PDPS (Patient Diagnosis Projection Similarity) 메트릭 + MIMIC-III 3-5 병원 시나리오 검증. DP/HE/MPC 비싼 기술 없이 임베딩 공유로 privacy 보호.

- RQ: 다기관 EHR 의 contextual embedding (개별 학습) 을 어떻게 align 하여 cross-hospital 예측 모형 을 구축할 수 있는가?

- 방법론: bilingual-autoencoder — 소스별 encoder + 공유 hidden space + cross-hospital reconstruction loss + 2-phase training

- 데이터: MIMIC-III, 3-5 병원 시뮬레이션 (medical event sequences)

- 주요 발견: (1) 소스별 분리 처리 + 공유 표현 alignment — HarmoAE 의 핵심 패턴. (2) Cross-hospital reconstruction loss 가 spontaneous alignment 유도. (3) 2-phase training — biased 병원 의 distortion 방지. (4) PDPS 메트릭으로 정렬 품질 정량. (5) 다양한 병원 size 시나리오 (large + small) 에서 both 개선.

- 시사점: DP, HE, MPC 의 비싼 보안 기법 없이 embedding 공유 만으로 prediction modeling 가능. Patient-level data 노출 X — 자연스러운 privacy 보호. 신규 병원 추가의 유연성.

요약

이 paper 는 이정혜 의 2 기 UNIST 시기 의 시그니처 작업 — “소스별 분리 + 공유 표현” 메타-아키텍처 의 첫 명시적 구현. Taek-Ho Lee (제 1 저자, UNIST 박사) 의 후속 paper 들 (HarmoSATE: Harmonized embedding-based self-attentive encoder to improve accuracy of privacy-preserving federated predictive analysis, taek-ho-lee-2023-w2v-fed-recommendation) 의 출발점.

방법론적 핵심: HarmoAE (Bilingual Autoencoder) — 자연어 처리의 bilingual word embedding alignment 에서 영감. 각 병원이 자신의 EHR 에서 contextual embedding 학습 (Word2Vec 또는 similar). 각 병원의 embedding 공간이 다르므로 직접 사용 불가능. HarmoAE 는:

- 병원별 encoder (자기 임베딩 → 공유 hidden space)

- 공유 hidden space 에서 cross-hospital reconstruction: 병원 의 임베딩을 hidden 으로 보낸 후 병원 의 decoder 로 reconstruct

- Reconstruction loss 가 encoder 들을 같은 hidden space 에 align 강제

2-phase training: (i) Phase 1: 동일 데이터로 pre-training (모든 encoder 가 합리적 시작점). (ii) Phase 2: joint training (cross-hospital reconstruction loss). Biased 병원 (e.g. small or unusual) 의 distortion 방지.

PDPS (Patient Diagnosis Projection Similarity): 두 병원의 환자 임베딩이 진단 동질성 에 따라 유사한지 측정.

핵심 발견: MIMIC-III 시뮬레이션 (3-5 병원) 에서 HarmoAE 가 기존 alignment 방법 (canonical correlation 등) outperform. 특히 크기 불균형 병원 (large + small) 에서 2-phase training 이 both 병원 prediction 개선. Privacy 측면에서 patient-level data 노출 없이 embedding (집계 통계) 만 공유 — DP/HE/MPC 같은 비싼 보안 불필요.

이정혜 의 연구 궤적 안에서 이 paper 는 실타래 2 (Privacy-preserving / FL) 의 중심 + 실타래 4 (Representation Learning) 의 발전. 후속 HarmoSATE: Harmonized embedding-based self-attentive encoder to improve accuracy of privacy-preserving federated predictive analysis (2024 self-attention 추가), taek-ho-lee-2023-w2v-fed-recommendation (federated recommendation) 으로 확장.

핵심 결과

| 항목 | 값 |

|---|---|

| 메타-아키텍처 | 소스별 분리 + 공유 표현 |

| 2-phase training | biased 병원 distortion 방지 |

| 정렬 메트릭 | PDPS (Patient Diagnosis Projection Similarity) |

| 데이터 | MIMIC-III, 3-5 병원 시뮬레이션 |

| Privacy 방식 | Embedding 공유 (patient-level 미공유) |

| DP/HE/MPC 필요? | No |

방법론 노트

For each hospital k ∈ {1,...,K}:

Encoder E_k: Embedding_k → SharedHidden (병원 k 의 임베딩 공간 → 공유 공간)

Decoder D_k: SharedHidden → Embedding_k (공유 공간 → 병원 k 의 임베딩)

Loss = ∑_{k,k'} ||D_{k'}(E_k(x_k)) - x_{k'}_aligned||²

+ reconstruction loss within hospitalCross-hospital reconstruction: 병원 의 embedding 을 의 decoder 로 reconstruct → 두 encoder 가 같은 hidden space 로 mapping 하도록 강제.

식별 가정: (i) Contextual embedding 의 non-patient-level 보호, (ii) Cross-hospital corresponding patients 또는 events 존재, (iii) Autoencoder 의 충분한 capacity.

연구 계보

이 paper 는 (i) Bahdanau et al. (2014) 의 bilingual seq2seq, (ii) Mikolov et al. (2013) Word2Vec 본가, (iii) Privacy-Preserving Patient Similarity Learning in a Federated Environment: Development and Analysis (federated patient matching) 직접 선행 — 의 결합. 이정혜 의 연구 궤적 실타래 2 + 4 의 중심, 후속 HarmoSATE 의 직접 선행.

See also

- 이정혜

- Taek-Ho Lee

- Chi-Hyuck Jun

- bilingual-autoencoder

- autoencoder

- harmonization

- distributed-ehr

- information-sciences

- Privacy-Preserving Patient Similarity Learning in a Federated Environment: Development and Analysis

인접 그래프

- 인물 3

- 논문 4

이 문서를 가리키는 페이지

논문 (3)

- HarmoSATE: Harmonized embedding-based self-attentive encoder to improve accuracy of privacy-preserving federated predictive analysis

- Privacy-Preserving Predictive Modeling: Harmonization of Contextual Embeddings From Different Sources

- Word2Vec-based efficient privacy-preserving shared representation learning for federated recommendation system in a cross-device setting