Classification of High Dimensionality Data through Feature Selection Using Markov Blanket

이정혜, Chi-Hyuck Jun (2015) · industrial-engineering-and-management-systems 14(2):210-219 · DOI ↗

이정혜 박사 연구의 이론적 핵심 — 3 개 markov-blanket (MB) 알고리즘 (iamb, mmmb, hiton-mb) 을 8 개 데이터셋 (마이크로어레이 포함) 에서 필터 방법 (CFS, MRMR) 과 체계적 비교. IAMB 이 가장 robust — 고차원 (2,000-15,114 features, 수십-수백 samples) 환경에서 극적 차원 축소 하면서 분류 성능 유지. 이정혜 의 실타래 1 (Feature Selection / MB) 의 출발점.

- RQ: 베이지안 네트워크의 Markov Blanket (MB) 가 고차원 데이터의 분류용 특성 선택 에 효과적인가? 3 가지 MB 알고리즘 중 무엇이 우월한가?

- 방법론: 3 markov-blanket 알고리즘 비교 — iamb (grow-and-shrink), mmmb (divide-and-conquer), hiton-mb (single-loop hybrid) + 필터 방법 (CFS, MRMR) baseline

- 데이터: 8 개 데이터셋 — 마이크로어레이 (high-dim 2,000-15,114 features), UCI 표준 데이터 등

- 주요 발견: (1) IAMB 가 가장 robust — 다양한 데이터셋에서 성능 안정. (2) 극적 차원 축소 + 분류 성능 유지 — 고차원 마이크로어레이에서 수십-수백 features 로 압축. (3) MMMB, HITON-MB 는 특정 데이터에 우수 하나 일관성 부족. (4) MB 가 이론적으로 최적 — 타겟 변수에 조건부 독립을 보장하는 최소 변수 집합.

- 시사점: 고차원 데이터 분석에 MB 기반 특성 선택 이 기계적 통계 (CFS, MRMR) 대비 이론적 + 실용적 우위. 마이크로어레이 같은 p ≫ n 환경에서 특히 가치.

요약

이 paper 는 이정혜 의 박사 연구의 핵심 작업 — 후속 모든 MB 기반 특성 선택 연구의 이론적 기초. Chi-Hyuck Jun (지도교수) 의 통계학 라인에 markov-blanket 이라는 베이지안 네트워크 도구 를 통합.

방법론적 핵심은 3 MB 알고리즘의 체계적 비교:

(i) iamb (Incremental Association MB) — grow-and-shrink. 종속 노드를 추가한 뒤 false positive 를 제거. 가장 simple + robust.

(ii) mmmb (Max-Min MB) — divide-and-conquer. 부모-자식 먼저 찾고, spouse node (자식의 부모) 탐색.

(iii) hiton-mb — 하이브리드. 추가/제거를 단일 루프에서 수행. 조기 false positive 제거.

8 개 데이터셋 (마이크로어레이 + UCI) 에서 분류기 (CART, kNN, SVM) 와 결합해 정확도 비교. 필터 baseline: CFS, MRMR.

핵심 발견: IAMB 이 가장 robust — 8 데이터셋 평균 성능에서 일관 우위. 고차원 마이크로어레이 (2,000-15,114 features) 에서 수십 features 로 축소하면서 분류 성능 유지 또는 향상. MMMB, HITON-MB 는 특정 데이터셋 에 더 우수 하나 일관성 떨어짐.

이정혜 의 연구 궤적 안에서 이 paper 는 박사 연구의 이론적 정점. 후속 Markov blanket-based universal feature selection for classification and regression of mixed-type data (2020 혼합형 데이터), junghye-lee-2021-mb-ranking (2021 멀티변량 순위화), kyu-jin-kim-2024-cafo (2024 KDD CAFO) 로 MB / 특성 선택 라인 이 10 년에 걸쳐 발전.

핵심 결과

| 알고리즘 | Robustness | 고차원 적합성 |

|---|---|---|

| IAMB | 최고 (consistent across datasets) | 우수 |

| MMMB | 특정 데이터 우수, 일관성 ↓ | 우수 |

| HITON-MB | 특정 데이터 우수 | 우수 |

| CFS (filter baseline) | 평균 | 평균 |

| MRMR (filter baseline) | 평균 | 평균 |

- 8 데이터셋 (마이크로어레이 + UCI)

- 차원 축소: 2,000-15,114 features → 수십-수백

- 분류 성능 유지 또는 향상

방법론 노트

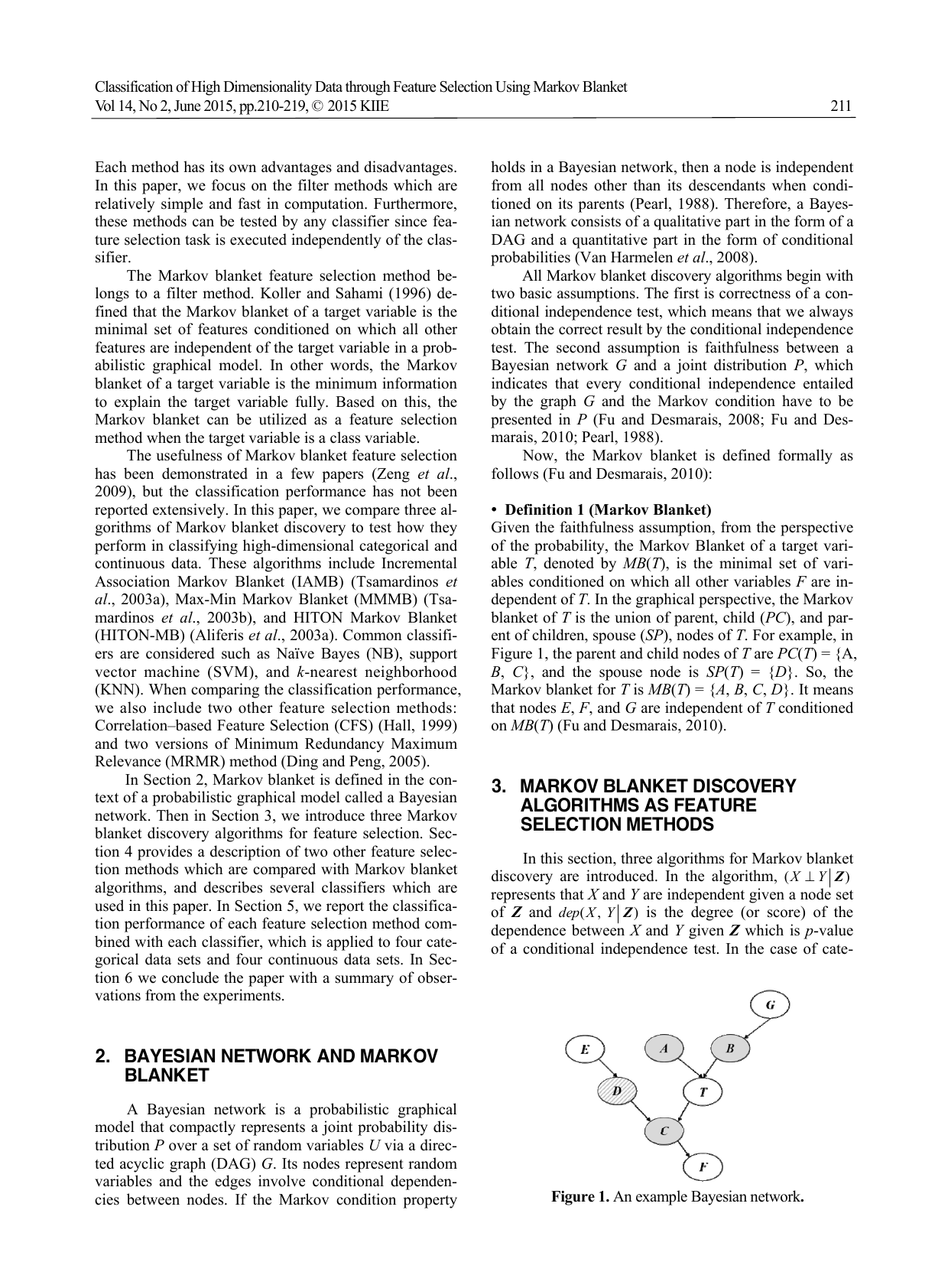

markov-blanket 정의: 타겟 에 대해, 조건부 독립을 보장하는 최소 변수 집합 . 베이지안 네트워크에서:

iamb (grow-and-shrink):

- Grow: 추가 if .

- Shrink: 제거 if .

조건부 (in)dependence 검정: G^2 (categorical) 또는 partial correlation (continuous).

식별 가정: (i) Faithfulness — joint distribution 이 BN graph 와 일치, (ii) 충분한 sample size — 조건부 독립 검정의 power.

연구 계보

이 paper 는 (i) Pearl (1988) 의 베이지안 네트워크 본가, (ii) Margaritis & Thrun (2000) 의 IAMB 본가, (iii) Aliferis et al. (2010) 의 MB 알고리즘 정통 — 의 결합. 이정혜 의 연구 궤적 실타래 1 (Feature Selection / MB) 의 출발점.

See also

- 이정혜

- Chi-Hyuck Jun

- markov-blanket

- iamb

- feature-selection

- high-dimensional-classification

- industrial-engineering-and-management-systems

인접 그래프

- 인물 2

- 방법론 1

- 논문 4

이 문서를 가리키는 페이지

논문 (4)

- An efficient multivariate feature ranking method for gene selection in high-dimensional microarray data

- CAFO: Feature-Centric Explanation on Time Series Classification

- Feature selection based on geometric distance for high-dimensional data

- Markov blanket-based universal feature selection for classification and regression of mixed-type data