Pursuing Overall Welfare in Federated Learning through Sequential Decision Making

Seok-Ju Hahn, Gi-Soo Kim, 이정혜 (2024) · icml 2024

AAggFF (Adaptive Aggregation for Federated Fairness) — federated learning 의 client-level fairness 를 online convex optimization + sequential decision making frame 으로 통합. 이정혜 의 ICML 2024 — 최상위 학회. Cross-device + cross-silo 변종 — sublinear regret bounds , . 기존 fairness-aware aggregation 방법들이 server 의 sequential decision 으로 통일 가능함을 보임.

- RQ: Federated learning 의 fairness-aware aggregation 전략을 통일된 이론 frame 으로 표현 가능한가? Cross-device + cross-silo 모두에서 최적 regret bound?

- 방법론: online-convex-optimization (OCO) frame + adaptive aggregation + cross-device/cross-silo 변종 + theoretical analysis

- 데이터: 비IID 시나리오, fairness benchmark federated datasets

- 주요 발견: (1) 기존 fairness-aware aggregation 이 OCO frame 으로 통일. (2) Cross-device regret , cross-silo . (3) AAggFF 가 기존 방법보다 우수한 client-level fairness. (4) Theoretical guarantees + practical performance.

- 시사점: Fairness in FL 의 theoretical foundation. Cross-device (모바일, 수천 clients) vs cross-silo (병원, 수십 silos) 의 practical 구분 + 각각 최적 방법. ICML 발표로 international recognition.

요약

이 paper 는 이정혜 의 3 기 SNU TEMEP 의 FL 이론 정점 — ICML 2024 (최상위 학회) 발표. Seok-Ju Hahn (SuPerFed 의 같은 제 1 저자) + Gi-Soo Kim (UNIST 산업공학, AI Graduate School) 의 협업. junghye-lee-2022-superfed (KDD 2022) 의 fairness 측면 확장.

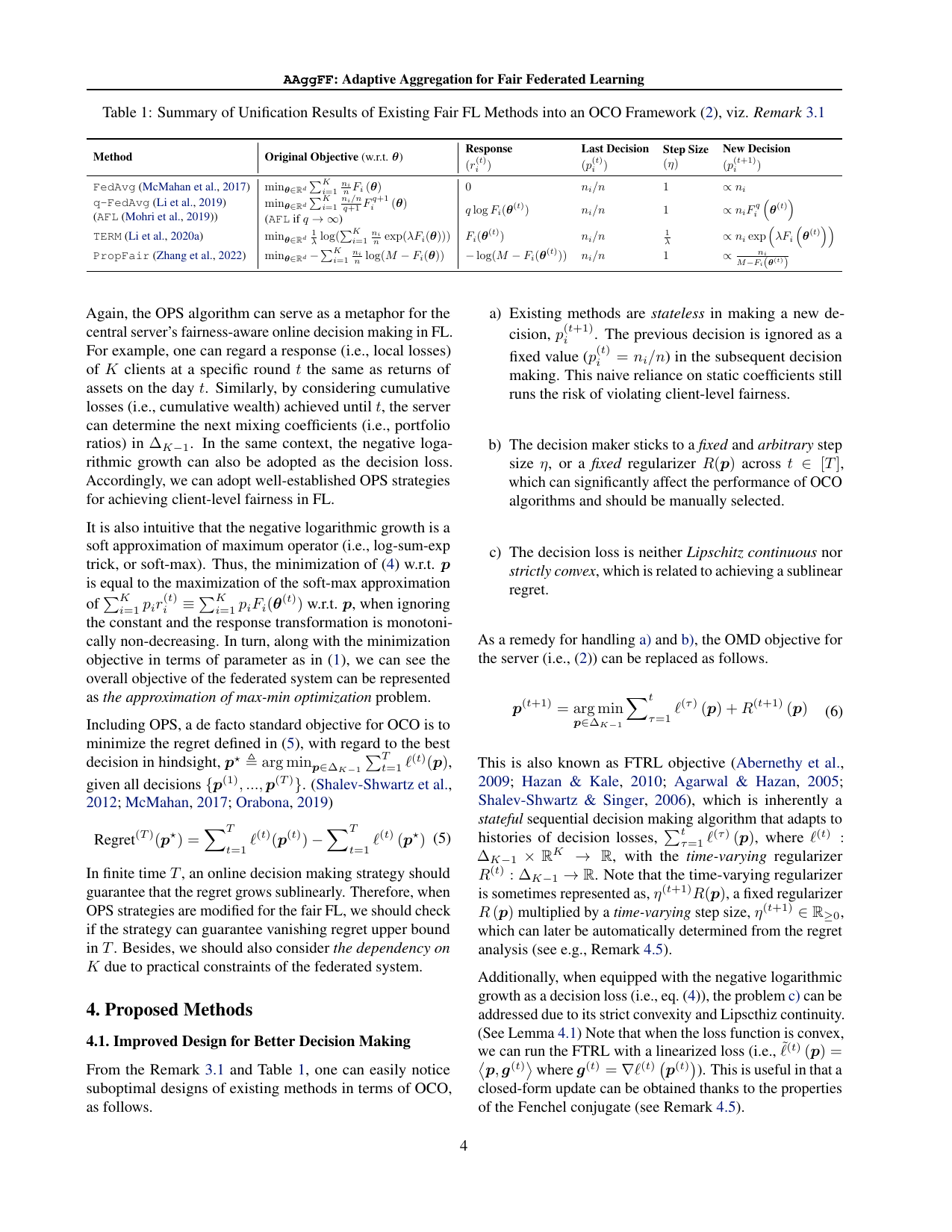

방법론적 핵심: Federated fairness 의 OCO 통일. 기존 fairness-aware aggregation:

- FedAvg — 단순 weighted average (fairness 무시)

- q-FFL — power-q mean 으로 unfairness 페널티

- FairFed — fairness gap 기반 weight 조정

- Ditto — local-global trade-off

이들이 모두 central server 의 sequential decision making (online convex optimization) 으로 표현 가능함을 발견. 즉 매 round 에서 aggregation weight 를 over time adapt.

AAggFF:

- Cross-device (수천 clients, 일부만 active per round): regret — FTRL (Follow-The-Regularized-Leader) 류

- Cross-silo (수십 silos, 모두 always active): regret — Exp3 류 (multi-armed bandit)

핵심 발견: AAggFF 가 기존 방법 outperform — client-level fairness 지표 우월. Theoretical regret bound 가 fast convergence 보장.

이정혜 의 연구 궤적 안에서 이 paper 는 실타래 2 (FL) 의 이론 정점 + 3 기 ICML 발표. Connecting Low-Loss Subspace for Personalized Federated Learning 의 자매 / 동일 제 1 저자 박사 연구 시리즈.

핵심 결과

| Setting | Regret Bound | Algorithm |

|---|---|---|

| Cross-device | FTRL-style | |

| Cross-silo | Exp3-style |

- ICML 2024 발표 (최상위 학회)

- Theoretical + practical performance

- Existing fairness aggregation 의 OCO 통일

방법론 노트

OCO formulation: 매 round 에 server 가 aggregation weights (probability simplex) 선택. Loss = unfairness measure.

FTRL update:

= regularizer (e.g. entropy).

식별 가정: (i) Loss function 의 convexity, (ii) Gradient access (sub-gradient), (iii) Cross-device 의 partial participation, cross-silo 의 full participation.

연구 계보

이 paper 는 (i) Cesa-Bianchi & Lugosi (2006) online learning 정통, (ii) Li et al. (2020) q-FFL 직접 선행, (iii) Connecting Low-Loss Subspace for Personalized Federated Learning 의 personalization 라인 연결 — 의 결합. 이정혜 의 연구 궤적 실타래 2 의 이론 정점.

See also

- 이정혜

- Seok-Ju Hahn

- Gi-Soo Kim

- online-convex-optimization

- federated-learning

- client-fairness

- icml

- Connecting Low-Loss Subspace for Personalized Federated Learning

인접 그래프

- 인물 3

- 논문 2