Connecting Low-Loss Subspace for Personalized Federated Learning

Seok-Ju Hahn, Minwoo Jeong, 이정혜 (2022) · kdd ‘22:505-515 · DOI ↗

이정혜 의 연합학습 연구 대표작 — KDD 2022 (25 회 인용, KDD 최상위 학회). SuPerFed (Connecting Low-Loss Subspace) — hypernetwork 기반 모델 혼합 + 로컬-글로벌 모델 간 low-loss subspace 연결성 (cosine 유사도) 정규화. SuPerFed-MM (모델 혼합), SuPerFed-LM (레이어 혼합). 비IID (pathological, Dirichlet) 환경에서 우수 성능. “파라미터 공간이 아닌 loss landscape 에서의 모델 혼합이 개인화에 효과적” — 이론적 기여.

- RQ: Non-IID 데이터 환경의 federated learning 에서 개인화 (personalization) 어떻게 효과적으로? 로컬 모델과 글로벌 모델의 적절한 혼합 은?

- 방법론: SuPerFed — hypernetwork 으로 mixing constant 생성 + 로컬-글로벌 low-loss subspace 연결성 cosine 정규화. 변종: SuPerFed-MM (model mixing), SuPerFed-LM (layer mixing)

- 데이터: 비IID benchmarks (pathological partition, Dirichlet partition) + 표준 federated learning datasets

- 주요 발견: (1) SuPerFed > 기존 personalized FL 방법 — 비IID 환경에서 우수. (2) Loss landscape 에서의 모델 혼합이 핵심 — 파라미터 공간 보다 효과적. (3) Layer mixing > Model mixing — 더 세밀한 개인화. (4) Low-loss subspace 의 연결성 이 ID 와 개인화의 균형.

- 시사점: KDD 최상위 학회 발표 → 국제적 인지도. Personalization 의 이론적 정밀화 — 단순 fine-tuning 또는 multi-task learning 의 한계 극복. 이정혜 2 기 UNIST 시기 의 시그니처 작업.

요약

이 paper 는 이정혜 의 *2 기 UNIST 시기 의 연합학습 대표작 — KDD 2022 (KDD 최상위 학회) 발표. Seok-Ju Hahn (제 1 저자, UNIST 박사) 의 D3M Lab 의 시그니처 작업. 이정혜 author page 의 전환점 2 (SuPerFed @ KDD).

방법론적 핵심: Low-loss subspace 개념 활용. 일반적으로 loss landscape 가 high-dim non-convex 인데, 동일 task 의 여러 minima 가 low-loss subspace (e.g. linear interpolation 또는 quadratic Bezier curve) 으로 연결 가능 함이 보고됨 (Garipov et al. 2018).

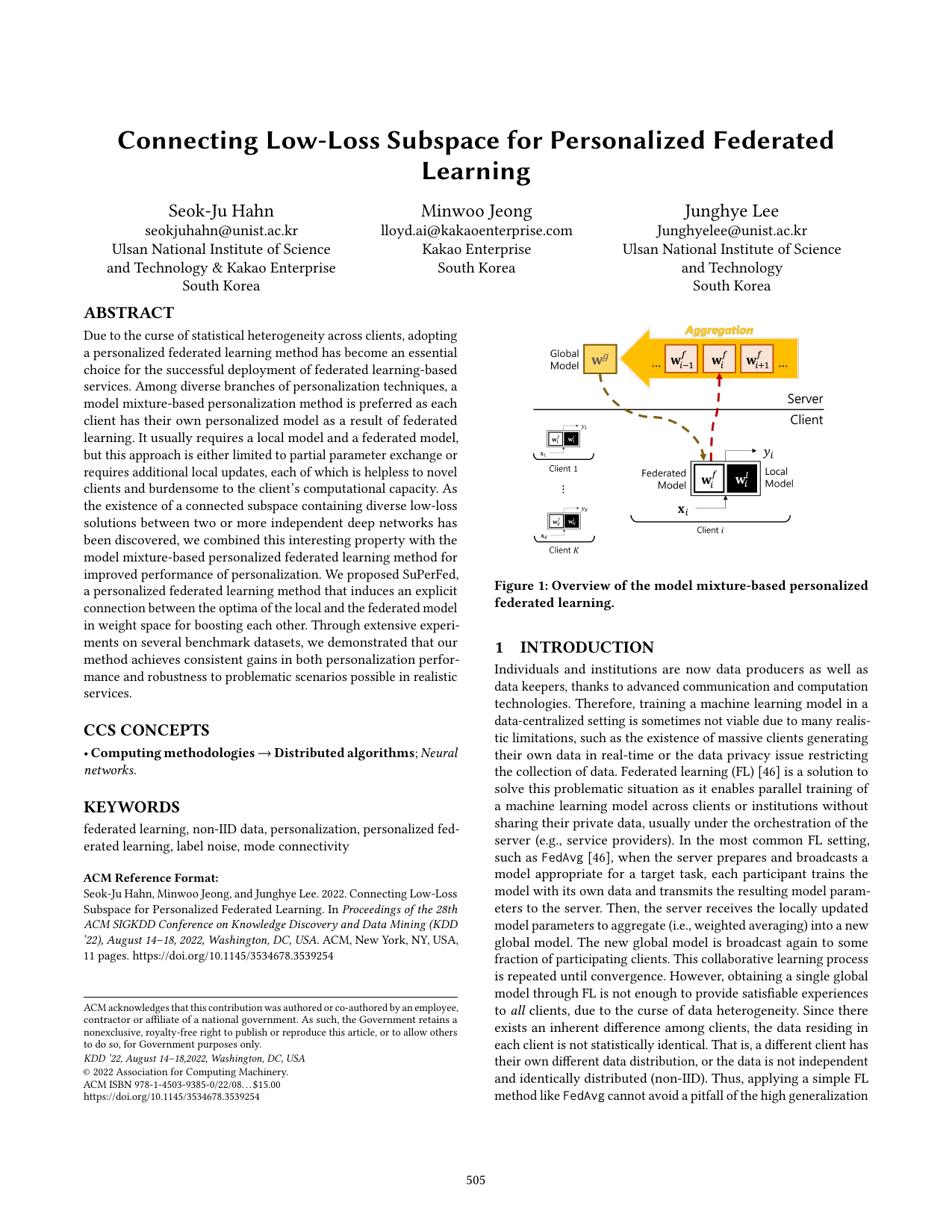

SuPerFed 아이디어: 로컬 모델 과 글로벌 모델 사이의 low-loss subspace 에서 mixing — 두 모델이 같은 task 의 다른 good solution. Mixing constant 는 hypernetwork (작은 NN) 가 생성.

Loss:

Cosine similarity 정규화가 low-loss subspace 의 연결성 강제 — 두 모델이 같은 ridge 위에 머물도록.

변종:

- SuPerFed-MM (Model Mixing): 전체 모델 파라미터에 적용

- SuPerFed-LM (Layer Mixing): 레이어별 — 더 세밀한 개인화

핵심 발견: 비IID benchmark (pathological — 각 client 가 1-2 class 만 보유; Dirichlet — Dirichlet distribution 기반 partition) 에서 SuPerFed > 기존 personalized FL (FedPer, pFedMe, Per-FedAvg 등). Layer mixing 이 더 우수 — 일부 layer 는 global 정보, 일부는 local 적응.

이정혜 의 연구 궤적 안에서 이 paper 는 실타래 2 (Privacy-preserving / FL) 의 정점. 전환점 2. 후속 seok-ju-hahn-2024-aagffl (2024 ICML 공정성) 으로 FL theory line 발전.

핵심 결과

| 방법 | 비IID 성능 |

|---|---|

| FedAvg (baseline) | 평균 |

| FedPer | 중간 |

| pFedMe | 중간 |

| Per-FedAvg | 중간 |

| SuPerFed-MM | 우수 |

| SuPerFed-LM | 최고 |

- KDD 2022 발표 (최상위 학회)

- 인용 수 25 (2 년 내)

- Low-loss subspace 개념의 federated learning 적용

방법론 노트

hypernetwork: 작은 신경망 , = client context (data 통계 또는 ID).

SuPerFed update:

For each client k:

Compute λ_k = h_φ(c_k)

Mixed model θ_k^mix = (1-λ_k)*θ^global + λ_k*θ_k^local

Compute loss on local data using θ_k^mix

Update θ_k^local via SGD

Send Δθ_k to server

Server:

Aggregate Δθ → update θ^global (FedAvg-style)

Update φ (hypernetwork)Cosine similarity 정규화 가 두 모델 간 거리 유지.

식별 가정: (i) Low-loss subspace 의 task connectivity, (ii) hypernetwork 의 적절한 capacity, (iii) cosine similarity 의 직접적 alignment.

연구 계보

이 paper 는 (i) Garipov et al. (2018) low-loss connectivity 본가, (ii) Ha et al. (2017) hypernetwork 정통, (iii) McMahan et al. (2017) FedAvg 본가, (iv) Privacy-Preserving Patient Similarity Learning in a Federated Environment: Development and Analysis 직접 선행 — 의 결합. 이정혜 의 연구 궤적 실타래 2 의 정점, 전환점 2.

See also

- 이정혜

- Seok-Ju Hahn

- federated-learning

- personalized-federated-learning

- hypernetwork

- kdd

- Privacy-Preserving Patient Similarity Learning in a Federated Environment: Development and Analysis

인접 그래프

- 인물 3

- 방법론 1

- 논문 3